极智算总结:

- 什么是大模型训练和推理

- 普通人必备的AI大模型核心术语:看懂它,轻松对话技术大牛!

- 深度学习训练卡和推理卡有何区别?

- 大模型推理需要多少算力

- 关于深度学习算力常识

- 数据,算法,算力与人工智能之间的关系分别是什么

- 人工智能第一回:AI算力概念篇

- 训练和推理的区别

- 【人工智能科普】什么是推理和训练AI芯片?

什么是大模型训练和推理

〖壹〗、大模型训练是通过大规模数据调整神经网络权重以构建高性能模型的过程,而推理则是利用这些训练好的模型对新数据进行快速准确分析的过程。以下是关于大模型训练和推理的详细解释:大模型训练: 定义:大模型训练是利用海量数据对神经网络模型进行训练,通过不断调整网络中的权重参数,使模型能够学习到数据中的特征和规律。

〖贰〗、大模型的威力源自其背后的训练和推理机制。简单来说,大模型就像一个能自我学习的智能机器,通过大规模的数据训练出复杂的神经网络模型。训练过程就像学生学习,利用海量数据调整网络权重,追求高性能和低能耗。而推理则是利用这些训练好的模型,对新的数据进行快速而准确的分析,注重用户体验和低延迟。

〖叁〗、训练是医院大模型应用的基础。通过训练,大模型能够从海量的医学数据中学习并提取有用的信息,从而提升其在医疗场景中的准确性和泛化能力。训练过程包括对数据的预处理、特征提取、模型构建和参数优化等多个环节。这些步骤共同确保了大模型能够学习到丰富的医学知识和临床经验。

〖肆〗、大模型,通常指的是基于深度学习的大型神经网络模型。其核心在于通过海量数据和强大的计算能力,模拟人类的思维过程,实现对复杂任务的处理。大模型的典型代表包括GPT、BERT、ChatGLM等,这些模型在自然语言处理、计算机视觉、语音识别等多个领域展现出强大的能力。大模型的诞生离不开深度学习技术的突破。

〖伍〗、推理:推理是深度学习模型应用的过程,将训练好的模型应用于新的、未见过的数据,以产生预测或分类结果。推理过程不需要计算后向梯度,只需使用训练好的模型参数进行前向计算。计算需求 训练:训练过程需要大量的计算资源,因为需要反复迭代地调整模型参数,并计算损失函数及其梯度。

普通人必备的AI大模型核心术语:看懂它,轻松对话技术大牛!

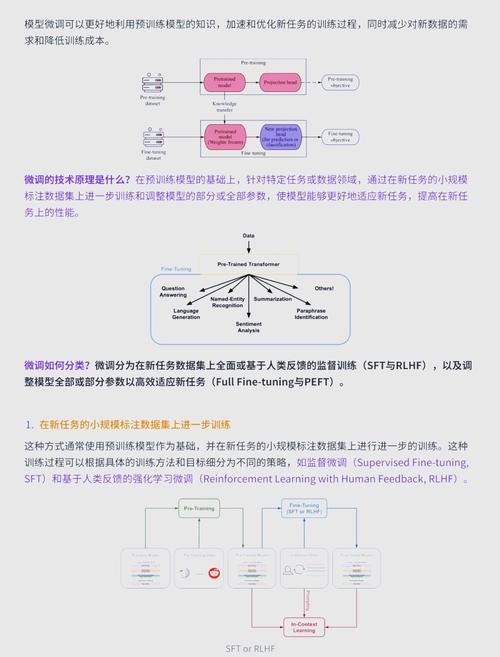

蒸馏(Distillation):大模型教小模型,保留能力,压缩体积。减脂(剪枝/量化):裁掉不重要的参数,提升运行速度,适合在移动设备部署。AI应用生态 智能体(Agent):像打包好的AI员工,懂指令、能行动,如AutoGPT。工作流(Workflow):安排多个AI协作的流程,如写稿、审稿、发布、推广等。

前沿模型:“前沿模型”是一个营销术语,指未发布的未来模型,理论上可能比现有AI模型更强大,但也可能带来显著风险。大模型训练的核心术语训练过程:AI模型的训练是通过分析数据集,理解数据并做出预测和识别模式的过程。大语言模型通过“阅读”大量文本进行训练。

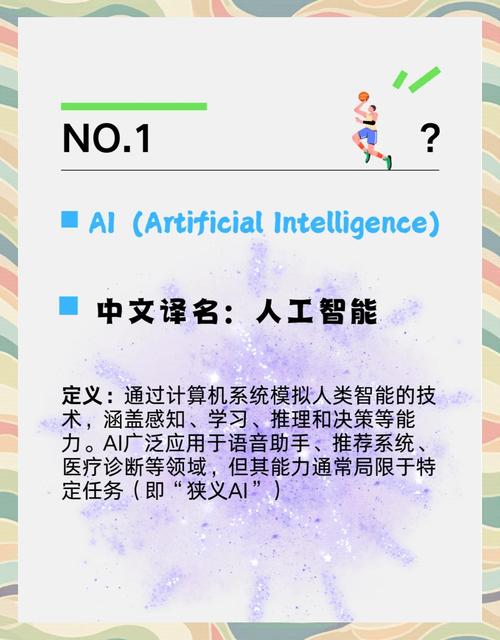

AI领域关键术语辨析AI(人工智能)AI旨在使机器能够执行通常需要人类智力的任务,是计算机科学的一个子领域。将AI视作一系列或一套工具是一个非常实用的思考方式,你可以把它看成是一套庞大的工具集,让电脑智能运行。在AI中,最大的子集可能是机器学习中的工具。

解释:大模型是近年来AI领域的一个热门话题,它们通常具有数亿甚至数十亿的参数,能够处理更加复杂和多样的任务。GAI(Generative AI,生成式AI)定义:能生成文本、图像、代码等内容的人工智能(如Midjourney、Stable Diffusion)。

深度学习训练卡和推理卡有何区别?

〖壹〗、探讨深度学习训练卡与推理卡的区别,首先需理解神经网络在训练与推理阶段的差异。训练时,神经网络利用随机梯度下降算法优化模型参数。此过程中,显存不仅承载模型参数,还需存储梯度信息,显存需求相比推理阶段增加数倍,需保证显存容量足够。此外,大量数据需读入显存,要求显存带宽足够大以支持大量数据的快速处理。

〖贰〗、推理可以使用训练卡,但训练却不能使用推理卡。因为训练卡具备更强大的计算能力和更高的性能要求,而推理卡则更注重高效、快速的数据处理能力。在选取显卡时,应根据具体的应用场景和预算来决定购买哪种类型的显卡。如果需要进行大规模模型训练,则应选取训练卡;如果只需要进行推理计算,则可以选取推理卡。

〖叁〗、需要注意的是,推理可以用训练卡,但训练不可以用推理卡。因为训练卡具备更强大的计算能力和更大的显存,可以满足训练过程中的复杂需求;而推理卡虽然优化了成本和功耗,但在处理大量数据和复杂模型时可能无法胜任训练任务。因此,在选取显卡时,需要根据具体的应用场景和需求来选取合适的类型。

大模型推理需要多少算力

视频处理大模型:以4K视频实时处理为例,为了保持30FPS(每秒帧数)的处理速度,所需的算力需求通常要大于等于180 TFLOPS(如使用NVIDIA L40 GPU,其带宽为864GB/s)。若进行多路视频并行处理,例如处理100路1080P视频流,至少需要8张A100 GPU来满足算力需求。

大模型所需的算力 大模型的训练需要巨大的算力支持。以GPT-3为例,其拥有1750亿参数,训练一次需要15×10^23 FLOP的算力需求。在2020年的算力水平下,如果仅使用一片V100 GPU,需要训练357年才能完成。为了缩短训练时间,需要增加硬件投入,但这会导致算力使用效率的下降。

B大模型(即70 billion,700亿参数)在FP16精度下,每个参数占用2字节,所以总共需要大约1400GB显存。这超出了单张GPU显卡的能力,因此需要使用多张GPU显卡并行处理。显卡配置:可能需要至少4张,甚至8张A100 80GB显卡来满足显存需求。或者使用H100的更高显存版本的显卡。

A100在大模型训练方面表现更优,而4090在大模型推理任务中性价比更高。以下是对两者的详细分析:大模型训练更喜欢A100算力优势:A100在TensorFP16算力上达到312Tflops,TensorFP32算力为156Tflops,虽然TensorFP16算力略低于4090的330Tflops,但在TensorFP32算力上远超4090的83Tflops。

达到人类水平的参数量约为 11 万亿,理论最优训练规模为训练 token 数等于参数量的 20 倍,即 228 万亿 token。模型参数量为 1375 万亿,理论训练 token 数为 1375*20=228 万亿个。当前模型规模表明,大模型效能还有提升空间,算力资源仍有未开发潜力。

关于深度学习算力常识

使用高性能的处理器,如GPU、TPU等,可以显著提升深度学习算力。优化硬件架构,如采用更先进的制程工艺、增加核心数量等,也可以提高算力。算法优化 通过优化深度学习算法,如使用更高效的神经网络结构、减少冗余计算等,可以在不增加硬件成本的情况下提升算力。

FLOPS(Floating-point operations per second)定义与意义 FLOPS,即每秒浮点运算次数,是衡量计算机或处理器性能的重要指标。在深度学习中,算力是决定模型训练速度和效率的关键因素之一。FLOPS值越高,表示处理器在单位时间内能够完成的浮点运算次数越多,从而能够更快地处理大规模数据集和复杂模型。

模型训练阶段的高算力需求深度学习模型训练是算力消耗的核心环节,尤其是大规模模型(如卷积神经网络CNN、循环神经网络RNN及基于Transformer的模型)。训练过程需通过多次迭代输入大型数据集,利用反向传播算法优化神经网络层的权重和偏差,以最小化预测输出与实际目标的损失函数。

数据,算法,算力与人工智能之间的关系分别是什么

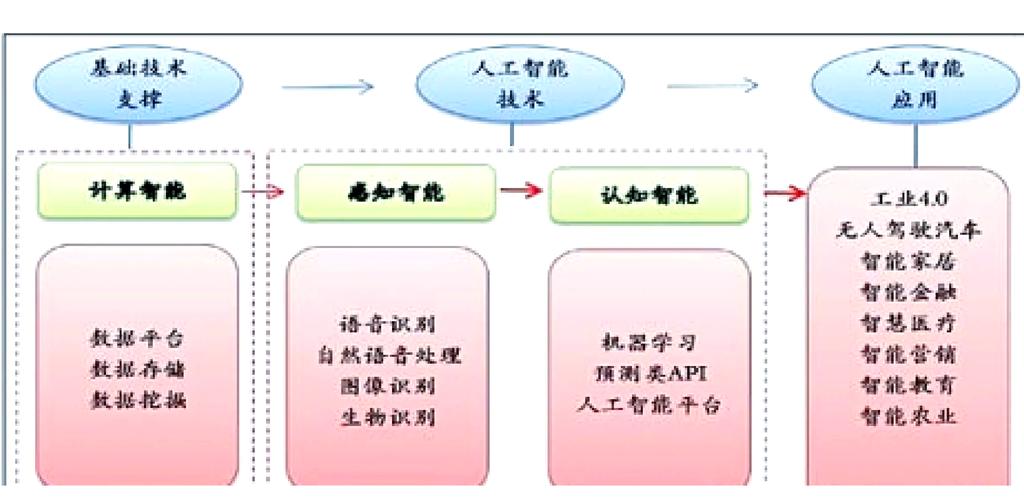

〖壹〗、数据、算法、算力是人工智能发展的三大核心要素,三者相互依存、协同作用,共同推动人工智能技术的突破与创新。数据:人工智能的“原材料”数据是人工智能系统运行的基础,涵盖文字、图像、声音、视频等多种形式的信息。其核心作用是为算法训练提供“素材”,算法通过学习海量数据中的模式和规律,逐步优化模型性能。

〖贰〗、人工智能的三个核心要素:算法、算力、数据 人工智能(Artificial Intelligence,简称AI)的快速发展依赖于三个核心要素:算法、算力、数据。这三个要素在人工智能领域中起着至关重要的作用,它们共同推动了人工智能技术的不断进步和应用拓展。

〖叁〗、“算法、数据、算力”确实是驱动人工智能发展的三要素。算法 算法是人工智能的核心,它决定了人工智能系统如何处理和理解数据。随着算法的不断创新和优化,人工智能系统的性能也在不断提升。深度学习、机器学习等算法的应用,使得人工智能在图像识别、语音识别、自然语言处理等领域取得了显著进展。

〖肆〗、算法是人工智能的“智慧”所在,决定了AI如何处理和分析数据。在图像识别领域,卷积神经网络(CNN)是一种常用的深度学习算法。通过大量的图像数据训练,CNN算法能够学习并识别图像中的特征,从而在图片中准确识别出人脸、动物、物品等目标。这种算法在人脸识别、自动驾驶等领域有着广泛的应用。

人工智能第一回:AI算力概念篇

算力可分为基础算力、智能算力和超算算力三部分,分别提供基础通用计算、人工智能计算和科学工程计算。基础算力:主要用于满足日常办公、网络通信、数据存储等通用计算需求。智能算力:专注于人工智能领域的计算,包括机器学习、深度学习等复杂计算任务,是支撑人工智能应用发展的核心力量。

人工智能算力要素包括应用、载体与核心芯片。应用方面,人工智能主要在大模型的训练与推理中实现。大模型通过训练学习,应用于图像识别、推荐系统等任务。训练阶段对算力要求较高,而推理阶段则相对较低。训练通常采用16位浮点数进行,支持32位与64位双精度计算,而推理则采用8位整型标志。

AI算力是支撑人工智能技术发展的核心计算能力,其需求随大模型技术兴起呈指数级增长,成为科技产业变革与资本市场关注的焦点。AI算力需求现状与增长趋势全球AI算力需求正经历爆发式增长。以大模型训练为例,GPT-4的算力需求较GPT-3提升超10倍,凸显技术迭代对算力的极致追求。

训练和推理的区别

推理:相比于训练过程,推理过程的计算需求要小得多。因为推理过程只是使用训练好的模型参数进行前向计算,不需要计算梯度或更新参数。因此,推理过程可以更快地执行,并且可以使用较少的计算资源。存储需求 训练:训练过程需要存储大量的中间结果和梯度信息,以便在反向传播过程中更新模型参数。

AI推理和AI训练的核心区别在于目标、过程、资源需求及应用场景的不同,具体可分为以下五方面:定义与目标差异AI训练的核心是通过大量标注数据和算法迭代,优化模型参数以构建预测或决策能力。例如,图像分类模型需通过数万张标注图片调整神经网络权重,最终实现准确识别。

训练和推理是机器学习过程中的两个核心阶段,它们在计算资源需求、硬件要求以及计算目标上存在显著差异。 计算资源需求: 训练阶段:需要处理复杂的反向传播计算,计算梯度以优化模型参数。此过程涉及大量数据和计算,要求高算力和内存以存储中间结果,进行梯度更新。

综上所述,推理和训练是深度学习中两个不可或缺的概念。训练过程使模型具备对未知数据的预测能力,而推理过程则利用这些能力来完成特定的任务。一个AI模型想要真正可以运行并完成推理任务,必须先经过充分的训练。

A100和4090的区别:训练卡与推理卡的差异 A100和4090是NVIDIA推出的两款高性能显卡,它们在设计上存在着明显的差异,以适应不同的计算需求。简而言之,A100更侧重于训练任务,而4090则更适用于推理任务。

A100是训练卡,主要用于深度学习模型的训练;而4090是推理卡,主要用于模型部署后的推理计算。以下是关于训练卡和推理卡的详细区别:功能与应用场景 训练卡:主要用于深度学习模型的训练阶段。需要处理大量的数据和复杂的计算任务,类似于大厨在厨房中烹饪复杂菜肴的过程。

【人工智能科普】什么是推理和训练AI芯片?

人工智能的实现包含推理与训练两大环节。推理,利用训练好的模型,运用新数据推断出结论,称为预测或推断。训练则是通过大量标记数据训练复杂神经网络,使其适应特定功能,要求高计算性能、处理大量数据和具备通用性。根据任务,AI芯片分为训练与推理芯片。

AI芯片,即人工智能芯片,是用神经网络、计算架构去构建模拟人类智能运算方式的芯片。它主要分为两个方向:推理和训练。推理芯片主要用于执行已经训练好的AI模型,对输入数据进行处理并输出结果;而训练芯片则用于训练AI模型,即通过学习大量数据来优化模型的参数。

AI芯片分为训练芯片和推理芯片,主要依据它们在人工智能系统中的不同作用。训练芯片专注于模型的训练阶段,利用大量数据和优化算法调整模型参数,使模型能从数据中学习到模式和规律。这一阶段的核心目标是通过迭代和参数优化,找到最佳参数设置,以实现对新数据的准确预测。

定义与目标差异AI训练的核心是通过大量标注数据和算法迭代,优化模型参数以构建预测或决策能力。例如,图像分类模型需通过数万张标注图片调整神经网络权重,最终实现准确识别。AI推理则是利用已训练好的模型,对新输入数据(如实时视频流)进行快速判断并输出结果,如自动驾驶系统根据路况数据生成转向指令。

人工智能从功能上来看包括推理和训练两个环节。训练环节通过大数据训练出一个复杂的神经网络模型,对芯片的算力性能要求较高;推理环节是指利用训练好的模型,使用大量数据推理出各种结论,对简单指令的重复计算和低延迟的要求很高。从应用场景来看,AI芯片应用于云端和设备端。

人工智能(AI)芯片大乱斗 广义上,所有面向人工智能(Artificial Intelligence,AI),包括Training(训练)和Inference(推理)应用的芯片都可以被称为AI芯片。随着人工智能技术的快速发展,AI芯片市场也迎来了前所未有的繁荣,各种不同类型的AI芯片如雨后春笋般涌现。

关于算力推理和训练的区别和联系到此分享完毕,希望能帮助到您。