极智算总结:

- A40显卡服务器CUDA程序无法访问指定的GPU

- 怎么调用服务器的gpu

- GPU服务器是什么?选深度学习GPU服务器看这里

- 阿里云服务器可以选取显卡吗

- gpu服务器与普通服务器的硬件区别

- 如何选取GPU服务器配置?

- GPU服务器需要什么配置

- GPU服务器的用处是什么?跟普通服务器有什么区别?

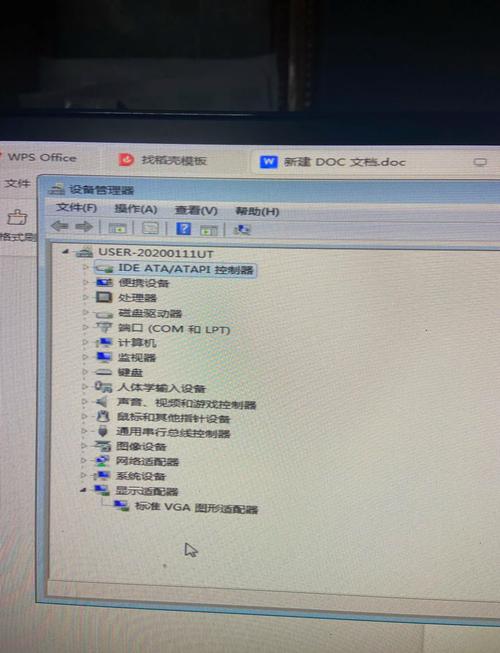

A40显卡服务器CUDA程序无法访问指定的GPU

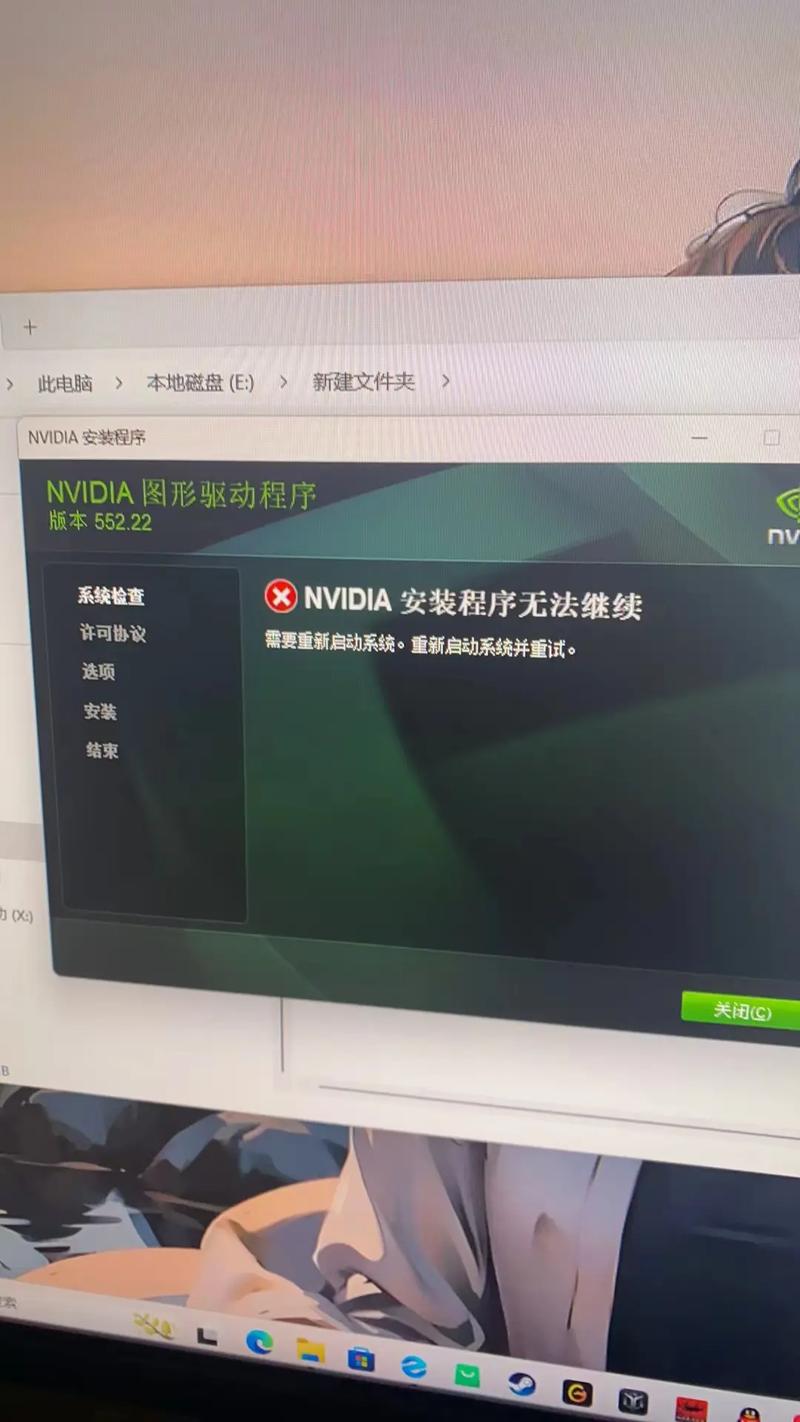

为了解决A40显卡服务器上CUDA程序无法访问指定GPU的问题,可采取以下步骤:首先,调整环境变量,例如设置`export CUDA_VISIBLE_DEVICES=0`,这样就能明确指定要使用的GPU,确保CUDA程序仅访问指定设备。其次,验证GPU索引设置,注意索引从0开始计数,确保准确指定目标GPU。

确认软件版本兼容性:确保你使用的DaVinci Resolve版本与你的显卡和驱动程序兼容。查看软件的更新日志或官方文档,了解是否有关于显卡兼容性的说明。调整GPU处理模式:尝试更改设置:在DaVinci Resolve的设置中,尝试取消勾选与GPU处理相关的选项,或更改处理模式(如从CUDA更改为OpenCL),看是否能解决问题。

GPU被其他进程占用或系统配置问题:原因:在多GPU系统中,GPU可能被其他进程占用,或者由于系统配置问题导致CUDA设备不可用。解决方案:使用nvidia-smi命令检查GPU的使用情况,确保没有其他进程占用GPU。同时,尝试以管理员身份运行程序,或者修改环境变量来限制CUDA程序只使用特定的GPU进行测试。

版本匹配:如果是在使用CUDA等GPU加速库,需要确保CUDA和cuDNN版本与NVIDIA驱动版本匹配。Docker环境:在Docker环境中运行应用时,需要安装NVIDIA Container Toolkit来支持GPU。服务器联网问题:网络检查:如果服务器未联网,可能导致无法使用nvidia-smi等命令查看GPU信息。

怎么调用服务器的gpu

在VSCode中远程连接到服务器并调用GPU:如果您习惯使用VSCode进行代码开发,可以通过配置远程连接插件(如Remote - SSH)连接到装备了GPU的服务器。在远程服务器上,您可以像在本地一样运行和调试使用GPU加速的代码,如PyTorch等深度学习框架。

GPU服务器的使用主要包括以下步骤: 明确应用需求:首先确定你要使用GPU服务器进行哪种类型的计算,如深度学习、科学计算或图形渲染等,因为不同的应用对GPU的型号和性能要求不同。 选取云服务提供商:根据你的需求和预算,选取一个合适的云服务提供商,比较其费用、性能、服务质量和支持情况。

下载链接需根据ESXi的具体版本进行选取,确保下载的驱动包包含ESXi主机驱动和虚拟机驱动。GPU显卡与物理服务器兼容性查询:在安装驱动前,务必查询GPU显卡与物理服务器的兼容性。访问NVIDIA官方网站的相关页面(如:NVIDIA vGPU认证服务器),查询并确认兼容性。

GPU服务器是什么?选深度学习GPU服务器看这里

NV-Link总线技术标准GPU服务器:NV-Link接口GPU的典型代表是NVIDIA V100,采用SXM2接口。具有NV-Link总线标准的GPU服务器可以分为两类:一类是英伟达设计的DGX超级计算机,另一类是英伟达合作伙伴设计的具有NV-Link接口的服务器。

GPU服务器是基于GPU的计算服务,适用于视频编解码、深度学习、科学计算等场景,提供高性能图形处理与计算能力;普通服务器则以CPU为核心,适用于常规办公、Web服务等低负载场景。两者在核心组件、应用场景、性能特点上存在显著差异。

GPU服务器是基于GPU应用在视频编解码、深度学习、科学计算等多场景下的稳定、快速且弹性的计算服务。GPU服务器的作用加速计算:GPU能够显著加快计算速度,通过将应用软件中的部分计算负荷迁移到GPU上,而CPU则继续运行其他代码。这种分工使得应用软件的运行速度得到明显提升。

GPU服务器是一种配备高性能图形处理器的服务器,其作用主要体现在图形处理与计算加速、深度学习与机器学习以及高性能计算集群等方面。 图形处理与计算加速: GPU服务器具备强大的并行处理能力,能够高效地进行图形处理和计算加速。

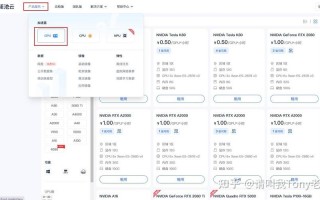

阿里云服务器可以选取显卡吗

〖壹〗、阿里云服务器可以选取显卡,其GPU服务器支持配置专业级GPU卡。

〖贰〗、阿里开源推理模型QwQ-32B的部署,服务器配置需根据量化方式和具体部署场景选取。以下是详细的配置建议:GPU显存 量化版本:若使用4bit量化(如32b-q4_K_M),24GB显存的显卡(如NVIDIA 3090、4090)即可支持推理。这种量化方式能够大幅降低显存需求,但可能损失部分性能。

〖叁〗、阿里云没有直接提供4060显卡配置的服务器,但提供了与4060对标配置的GPU服务器,费用根据实例类型和配置有所不同。

〖肆〗、对于需要机器学习训练、大模型处理或多卡需求的用户来说,阿里云GPU服务器无疑是一个值得优先考虑的选取。

〖伍〗、首先,用户需要选取一家提供显卡云服务器免费试用服务的云服务提供商。近来市场上知名的云服务提供商如阿里云、腾讯云、华为云、AWS、Azure等都提供了类似的免费试用服务。用户可以根据自己的需求和偏好,选取一家合适的云服务提供商。

〖陆〗、如果用户需要进行更复杂的图形处理、视频渲染或游戏等高性能需求,可以选取带有GPU显卡的无影云桌面规格。因此,阿里云无影云桌面是否带集成显卡,取决于用户购买时选取的配置规格。用户可以根据自己的实际需求,在阿里云官方渠道或合作伙伴处选取合适的无影云桌面规格,以满足自己的工作和娱乐需求。

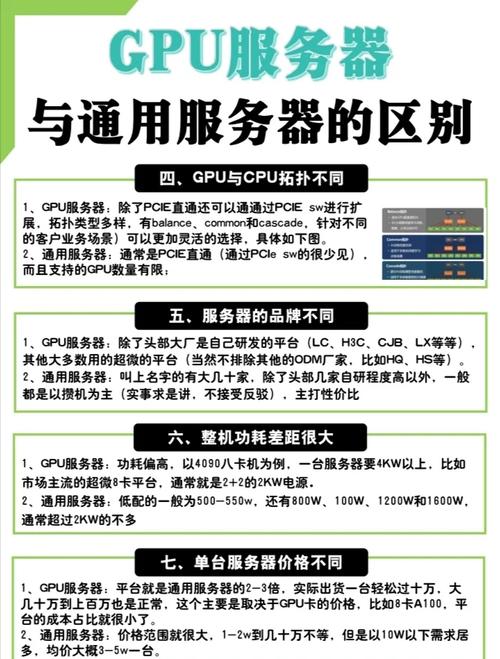

gpu服务器与普通服务器的硬件区别

GPU服务器和普通服务器之间的主要区别在于它们所针对的工作负载类型以及为此优化的硬件配置。以下是两者之间的一些关键差异:处理器(CPU)普通服务器:通常配备多核高性能中央处理器(CPU),这些CPU适用于处理大量并发请求或执行复杂的计算任务,如数据库查询、Web服务等。

成本GPU服务器硬件成本高,但单位算力成本低;普通服务器初始投入低,但扩展成本可能更高。服务器CPU与普通CPU的六大区别指令集不同服务器CPU采用RISC(精简指令集),优化特定任务;普通CPU采用CISC(复杂指令集),兼顾通用性。

GPU服务器:由于配备了高性能的GPU和其他相关硬件,费用相对较高。普通服务器:费用相对较为亲民,根据具体配置和品牌有所不同。管理与维护:GPU服务器:由于硬件配置的特殊性,可能需要更专业的技术人员进行管理和维护。普通服务器:管理和维护相对较为简单,一般技术人员即可完成。

GPU服务器:由于配备了高性能的GPU和相关的硬件资源,GPU服务器的费用通常较高。普通服务器:费用相对较为亲民,适合预算有限的用户或企业。稳定性与可靠性:GPU服务器:通常设计为能够长时间稳定运行,以满足高性能计算任务的需求。它们通常具有更高的可靠性和稳定性要求。

显卡服务器(GPU服务器)与普通服务器的区别主要体现在以下几个方面:处理器类型 普通服务器:通常配备中央处理器(CPU)作为主要处理器,用于执行大部分通用计算任务和操作系统管理。CPU设计用于处理广泛的计算任务,包括逻辑运算、数据移动和输入输出操作等。

显卡服务器与普通服务器的区别主要包括以下几点:硬件配置与性能:普通服务器:主要依靠中央处理器进行单线程或小规模并行计算,性能适用于常规任务。GPU服务器:额外搭载了强大的图形处理器,拥有数千个并行计算核心,能同时处理大规模数据和图形密集任务,计算性能远超普通服务器。

如何选取GPU服务器配置?

〖壹〗、CPU性能:选取强大的多核CPU(如Intel Xeon系列或AMD EPYC系列),以支持GPU的性能发挥。内存配置:根据任务需求选取内存容量,深度学习和大数据分析任务通常需要较大容量内存(如32GB或64GB)。存储性能:高速SSD存储能加快数据加载和读取速度,提高整体效率。

〖贰〗、选取GPU型号 边缘服务器:在边缘服务器租用上,需根据业务量和使用场景来选取GPU型号。例如,对于火车站卡口、机场卡口或公安卡口等场景,可能需要选取T4或P4等型号的GPU服务器。中心端Inference:在中心端进行Inference时,可能需要考虑吞吐量、使用场景和数量等因素,选取如V100等高性能GPU服务器。

〖叁〗、首先明确业务需求,确定是否需要GPU服务器的高性能计算能力。如果业务涉及深度学习、科学计算等需要大量并行计算的场景,则应选取GPU服务器。GPU接口类型:根据服务器的硬件配置和业务需求,选取合适的GPU接口类型,如PCIe、NVLink等。

〖肆〗、GPU服务器需要以下关键配置:高性能的GPU:核心部件:高性能GPU是GPU服务器的核心,直接影响服务器的处理能力。选取要点:通常选取专业级GPU,如NVIDIA的Tesla或Quadro系列、AMD的Radeon Instinct系列。需关注内存容量、浮点计算能力(TFLOPS)、内存带宽及最大显示分辨率。

GPU服务器需要什么配置

〖壹〗、GPU服务器需要以下关键配置:高性能的GPU:核心部件:高性能GPU是GPU服务器的核心,直接影响服务器的处理能力。选取要点:通常选取专业级GPU,如NVIDIA的Tesla或Quadro系列、AMD的Radeon Instinct系列。需关注内存容量、浮点计算能力(TFLOPS)、内存带宽及最大显示分辨率。

〖贰〗、内存配置:根据任务需求选取内存容量,深度学习和大数据分析任务通常需要较大容量内存(如32GB或64GB)。存储性能:高速SSD存储能加快数据加载和读取速度,提高整体效率。网络带宽:对于大规模数据传输,选取支持10GbE或更高网络速度的服务器。考虑预算与性价比 高性能GPU通常成本较高,需在性能和预算间平衡。

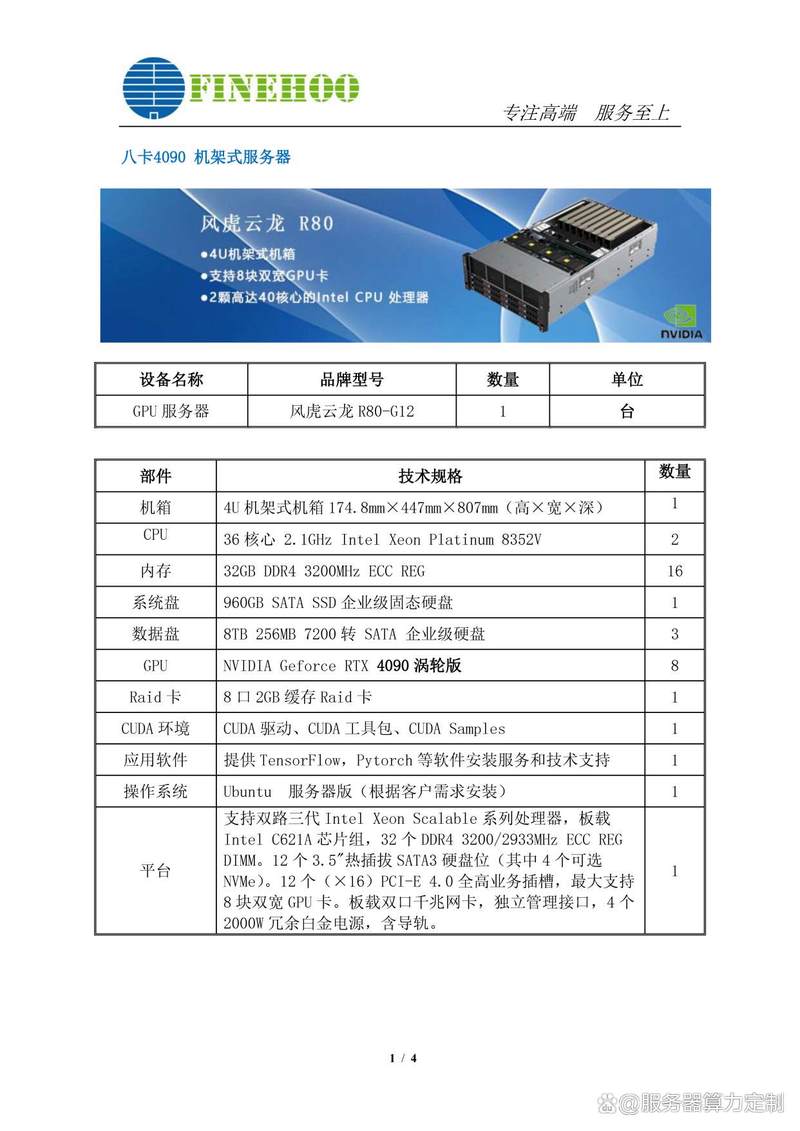

〖叁〗、GPU服务器的典型配置如下:CPU:类型:Intel Xeon 或 AMD EPYC系列。核心数:至少16核,以提供强大的多任务处理能力。主频:至少0GHz,确保高效的处理速度。缓存:至少64MB,以加快数据访问速度。GPU:类型:NVIDIA Tesla、Quadro或GeForce系列,专为并行计算而设计。

〖肆〗、GPU服务器:不仅需要充足的系统内存来支持操作系统和其他应用程序,还需要为每个GPU分配专用的显存(VRAM)。显存用于存储GPU处理过程中的临时数据,对于处理大规模数据集和复杂图形任务至关重要。因此,GPU服务器的内存配置通常更高,以满足GPU的显存需求。

GPU服务器的用处是什么?跟普通服务器有什么区别?

〖壹〗、GPU服务器是基于GPU的计算服务,适用于视频编解码、深度学习、科学计算等场景,提供高性能图形处理与计算能力;普通服务器则以CPU为核心,适用于常规办公、Web服务等低负载场景。两者在核心组件、应用场景、性能特点上存在显著差异。

〖贰〗、视频编解码:GPU服务器可以加速视频编解码过程,提高视频处理效率。深度学习:GPU服务器具有强大的计算能力,可以作为深度学习训练和预测的平台,加速深度学习模型的训练和推理过程。科学计算:在科学计算领域,GPU服务器可以加速复杂计算任务,提高计算效率。

〖叁〗、普通服务器:虽然也具有一定的稳定性和可靠性,但相对于GPU服务器来说,其设计可能更注重成本效益和易用性。扩展性与灵活性:GPU服务器:通常具有较高的扩展性和灵活性,可以根据需要添加更多的GPU或升级其他硬件资源。

〖肆〗、显卡服务器(GPU服务器):由于GPU的大规模并行计算特性,其功耗较高。因此,GPU服务器需要更多的电力供应来支持其高性能的计算任务。硬件成本 普通服务器:相对较低的硬件成本,适用于小规模的计算需求。普通服务器的硬件配置相对简单,因此其成本也相对较低。

〖伍〗、GPU服务器和普通服务器之间的主要区别在于它们所针对的工作负载类型以及为此优化的硬件配置。以下是两者之间的一些关键差异:处理器(CPU)普通服务器:通常配备多核高性能中央处理器(CPU),这些CPU适用于处理大量并发请求或执行复杂的计算任务,如数据库查询、Web服务等。

〖陆〗、GPU服务器和普通服务器的主要区别如下:核心功能与应用场景 GPU服务器:基于GPU构建,主要应用于视频编解码、深度学习、科学计算等多种需要高性能计算的场景。GPU服务器提供快速、稳定、弹性的计算服务,并具备和标准云服务器一致的管理方式。

OK,本文到此结束,希望对大家有所帮助。