极智算总结:

- 闪电云算力5090GPU租用:赋能未来科技,突破极限算力需求

- (转载)一文看懂英伟达A100、H100、A800、H800、H20

- GPU、GPGPU、NPU、TPU的区别

- 从新基建谈GPU算力(一)

- GPU算力租用平台如何助力AI模型训练

- GPU算力

- gpu服务器是什么?有什么作用?

闪电云算力5090GPU租用:赋能未来科技,突破极限算力需求

〖壹〗、使用闪电云算力5090GPU租用服务非常简单。用户只需要通过闪电云官方网站注册账号,选取合适的GPU型号和租用时长,即可开始使用。闪电云还提供免费的技术询问和部署指导,确保用户在租用过程中得到全面支持。结语 随着科技的不断发展,计算需求呈现出指数级增长。

〖贰〗、电动 汽车 前后双电机的结构布局,为 智能四驱 与 强大性能 提供了优秀的基础。此次,极氪带来“闪电切换”和“智能防滑”两大 科技 加持的“智能驱动”系统,意图重新定义高性能纯电动赛道,但作为行业内技术偏执的性能标杆智己L7所树立的性能基准也非一时能够突破。

(转载)一文看懂英伟达A100、H100、A800、H800、H20

H100在Transformer-based AI任务(如GPT)中比A100快6倍,而推理吞吐量也更高。小结 AI训练:需要高带宽 + 高精度计算,推荐H100/A100及其变种。AI推理:需要低延迟 + 高吞吐量,推荐H100/H800/H20。H100在Transformer模型训练和推理吞吐量方面遥遥领先。A100/A800仍然是中等预算下的优秀选取。

对于AI训练任务,建议选取H100或A100系列GPU,它们提供强大的计算能力和高带宽内存,适合处理大规模数据集和复杂模型。推理场景 对于AI推理任务,A800或H800系列GPU是更好的选取。它们提供稳定的计算能力和适中的内存容量与带宽,满足大多数推理任务的需求。

A100:拥有40GB显存,提供PCIE版和SXM版两种形式。A100是英伟达上一代的高性能GPU,广泛应用于AI计算、高性能计算等领域。A800:作为A100的替代产品,A800同样拥有80GB显存(与后续提到的H100、H800的某版本相同),也提供PCIE版和SXM版。

A100和A800:均属于Tesla系列中的高性能计算(HPC)和人工智能(AI)加速型号。A100是NVIDIA推出的旗舰级AI加速GPU,而A800则是针对中国市场推出的特供版(低配版)。H100和H800:同样属于Tesla系列,但更侧重于大模型训练和推理。

GPU、GPGPU、NPU、TPU的区别

GPGPU是图形处理器(GPU)的一种,但与其他GPU不同的是,GPGPU不是用来绘制电脑动画,而是协助中央处理器(CPU)分担工作。GPGPU结合了GPU的并行计算能力和CPU的通用处理能力,使得它能够在平行运算应用中发挥出色。由于GPGPU拥有大量的核心数,它胜任的工作种类虽然不及CPU广泛,但擅长处理大量图像数据。

综上所述,GPGPU与NPU作为AI加速芯片的代表,侧重点与设计逻辑不同。GPGPU凭借其成熟的通用计算能力与广泛软件生态,在大规模AI训练中占据重要地位。而NPU虽在特定任务上表现出色,但在软件生态与通用性方面,与GPGPU相比仍有差距。

设计初衷与功能侧重点 GPGPU:源自图形计算领域,其架构设计不仅注重图形通用计算,还强化了AI张量计算。配置有大量CUDA与Tensor核心,支持高精度计算,适用于广泛的计算任务。 NPU:专为深度学习与AI推理设计,采用特定的架构,包含AI Core与复杂缓存系统等组件,专注于提供高性能的AI计算能力。

GPGPU GPGPU由GPU的架构演进而来,并能使用更高级别的编程语言,在性能和通用性上更加强大,是近来AI加速服务器的主流选取。中科曙光提供高端计算机、存储、服务器等ICT基础设施,其GPGPU产品深算一号是最早实现商业化的国产GPGPU芯片。总结 随着AIGC商业化应用的加速落地,AI芯片市场将迎来高速增长。

灵活性:支持多种神经网络结构和算法,适应不同的应用场景。低功耗:在保持高性能的同时,降低了功耗,适合在移动设备、边缘设备等场景中使用。

在AI淘金热中,GPGPU是更有力的“钻头”,相较于NPU。以下是具体原因分析: 多功能与并行计算能力: GPGPU具备强大的多功能计算能力,尤其擅长大规模并行计算,这对于AI训练中的大规模数据处理至关重要。

从新基建谈GPU算力(一)

GPU算力作为新基建中大数据中心的核心,是支撑人工智能、5G等网络新经济的关键技术,其发展直接推动新基建各领域效率提升与成本优化。

基建:确保充裕的供电及制冷条件,以支持GPU集群的高负载运行。GPU计算模块:数据中心级GPU(如A100):适合训练大型数据集及模型,支持NVLINK,具备高显存和混合精度计算训练能力。GeForce系列GPU(如RTX4090):性价比较高,但显存有限,不支持NVLINK,适合中小规模或对数据集和训练精度要求不高的场景。

数字化转型的基础,就是“新基建”。新基建将覆盖包括区块链在内的新技术基础设施,算力将成为新生产力。联接和计算是新基建的两个核心,一是联接网络、平台,二是计算,包括算力、算法。围绕新基建,算力是核心、数据是要素。

搭建一个算力平台的成本因规模、硬件选型、技术方案及区域条件差异显著,整体投入范围从数百万元到数十亿元不等。具体成本需结合以下因素综合评估:不同规模算力平台的典型成本1000P算力平台整体投入达数十亿人民币级别,其中硬件成本占比比较高(60%-70%)。

算力可贵,效率价高:智算中心凭啥是筑基新基建的最优解?在新基建浪潮下,人工智能正成为经济增长的新引擎,各行各业正开启智能化升级转型。算力在其中扮演了重要角色,是国家未来竞争力的集中体现。

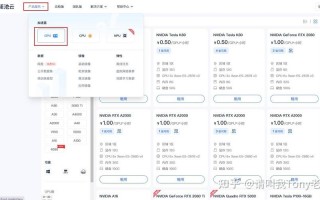

GPU算力租用平台如何助力AI模型训练

〖壹〗、GPU算力租用平台通过云计算技术,实现了高效的资源调度和弹性扩展。当用户需要进行大规模训练时,平台可以快速扩展算力资源,确保训练任务顺利进行。而当计算需求较小时,用户则可以降低租用资源,避免不必要的成本浪费。这种灵活性大大提高了用户的计算效率和成本效益,使得AI模型训练更加高效、快捷。

〖贰〗、DAMODEL(丹摩智算)是一个值得推荐的GPU算力租赁平台。它提供了强大的硬件支持、简便的操作流程、专业的技术支持以及经济实惠的费用。无论是学生党还是职业开发者,都可以通过该平台获得所需的计算能力,推进项目的开发工作。如果你正在寻找一个既经济实惠又性能强大的GPU算力租赁平台,不妨尝试一下DAMODEL。

〖叁〗、DAMODEL(丹摩智算)GPU算力租赁平台介绍 DAMODEL是一个专业的GPU算力租赁平台,它提供了丰富的GPU资源选取和优秀的用户体验,非常适合需要高效计算支持的开发者。强大的硬件配置:DAMODEL平台提供了高达124GB的内存和100GB的系统盘空间,足以应对大规模数据处理和复杂模型训练的需求。

GPU算力

GPU算力作为新基建中大数据中心的核心,是支撑人工智能、5G等网络新经济的关键技术,其发展直接推动新基建各领域效率提升与成本优化。

GPU在算力方面的优势:高密度计算能力:GPU构架相对简单但运算核心多,适用于大量逻辑简单但高并发量的高密度计算。高效支持并行编程:GPU的并行编程模式对庞大但逻辑简单的算力需求有明显更强更高效的支持能力,这也是AI领域更倾向于使用GPU的原因之一。

GPU算力是计算机领域中用于加速计算的重要资源。GPU算力的优势 并行计算能力强:GPU相比于CPU,具有更多的并行计算单元。这些计算单元被称为CUDA核心,每个核心可以同时执行多个线程,从而实现大规模的并行计算。这种并行计算能力使得GPU在处理大规模数据时比CPU更加高效。

昆仑芯P800 GPU的算力约为256 TFLOPS(FP16精度),属于高性能AI计算卡,主要面向深度学习训练与推理场景。核心算力参数 FP16精度:公开资料显示其峰值算力达256 TFLOPS,与NVIDIA A100(312 TFLOPS FP16)属于同一量级。 INT8算力:推测可达512 TOPS(典型1:2比例),适合低精度推理任务。

GPU的算力指的是GPU的计算能力,通常用FLOPS来表示。FLOPS是“floating-point operations per second”的缩写,意为“每秒所执行的浮点运算次数”,它被用于对GPU的计算能力进行估算。

gpu服务器是什么?有什么作用?

〖壹〗、GPU服务器是基于GPU的应用于多种场景的快速、稳定、弹性的计算服务。其出色的图形处理能力和高性能计算能力提供极致计算性能,有效解放计算压力,提升产品的计算处理效率与竞争力。GPU服务器的主要用处包括但不限于以下几个方面:视频编解码:GPU服务器可以加速视频编解码过程,提高视频处理效率。

〖贰〗、GPU服务器是一种配备高性能图形处理器的服务器,其作用主要体现在图形处理与计算加速、深度学习与机器学习以及高性能计算集群等方面。 图形处理与计算加速: GPU服务器具备强大的并行处理能力,能够高效地进行图形处理和计算加速。

〖叁〗、GPU服务器是一种配备了高性能图形处理器的服务器,其主要作用是进行高性能计算、图形渲染和深度学习等任务。以下是关于GPU服务器的详细解释:定义 GPU服务器通过集成高性能的图形处理器,能够执行复杂的图形处理和大规模数据并行运算任务。

〖肆〗、GPU服务器是基于GPU的应用于多种场景(如视频编解码、深度学习、科学计算等)的快速、稳定、弹性的计算服务,而普通服务器则主要用于满足日常的网络访问、数据存储和处理等基本需求。以下是两者之间的详细对比:应用场景:GPU服务器:主要面向需要高性能计算能力的场景,如深度学习训练、图形渲染、科学计算等。

〖伍〗、GPU服务器的作用:GPU能够加速计算,提供卓越的应用软件性能。通过将应用软件计算的一部分工作负荷迁移到GPU,同时仍由CPU运行其他代码,从用户的角度来看,应用软件的运行速度会显著加快。这是因为GPU与CPU在处理任务的方式上存在显著差异。

〖陆〗、GPU服务器:基于GPU构建,主要应用于视频编解码、深度学习、科学计算等多种需要高性能计算的场景。GPU服务器提供快速、稳定、弹性的计算服务,并具备和标准云服务器一致的管理方式。普通服务器:通常用于一般的办公场景、数据存储、网站托管等,其计算能力和图形处理能力相对有限,无法满足高性能计算需求。

关于云计算gpu,云计算gpu平台的介绍到此结束,希望对大家有所帮助。