极智算总结:

- GPU服务器怎么选取呢?

- 对比H100与4090:两者谁才是更好的GPU算力选取?

- 8块4090显卡!机架式GPU服务器方案

- 阿里云4060或4090显卡配置多少钱?GPU服务器最新费用总结

- 美国4090显卡服务器:提升渲染效率与画质的终极选取

- 2024年8月!!!当下最火GPU服务器你知道是哪几款吗?

GPU服务器怎么选取呢?

〖壹〗、阿里云GPU服务器:全球覆盖,企业级稳定;提供T4/V100/A100等多种GPU型号选取;费用相对较高,但性能稳定可靠。腾讯云GPU服务器:国内低延迟,BGP优化;提供T4/A10/A100等GPU型号选取;适合游戏、直播等国内业务场景。

〖贰〗、预算充足:若预算充足,可以选取性能卓越的服务器配置,如风虎云龙 RH88。这样的服务器不仅拥有强大的硬件配置,还可以根据具体需求进行定制化,从 CPU、内存、硬盘到 GPU 等各个组件都能按照自身要求进行选配,打造完全符合自己需求的高性能服务器。

〖叁〗、图形渲染与视频处理:选取图形处理能力强的GPU,如NVIDIA Quadro系列或AMD RadeonPro系列。考虑服务器的性能指标 CPU性能:选取强大的多核CPU(如Intel Xeon系列或AMD EPYC系列),以支持GPU的性能发挥。内存配置:根据任务需求选取内存容量,深度学习和大数据分析任务通常需要较大容量内存(如32GB或64GB)。

〖肆〗、显存容量的选取需根据模型参数规模来确定,一般遵循公式:显存容量 ≥ 模型参数规模(GB)× 2(考虑中间变量)。例如,训练100亿参数模型至少需要24GB显存,RTX 4090的24GB显存即可满足需求,而盲目选取更高显存的A100则会浪费成本。

〖伍〗、根据应用场景选取GPU服务器。确保所选服务器能够满足特定业务对计算性能的需求。关注性能指标:精度:根据应用需求选取合适的计算精度。显存:确保显存足够大,以容纳大规模数据集和模型。功耗:考虑服务器的功耗和散热性能,以确保稳定运行。选取服务器类型:根据需求选取OEM或非OEM服务器。

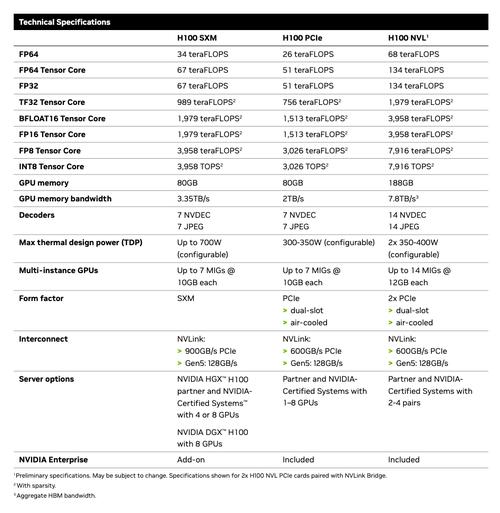

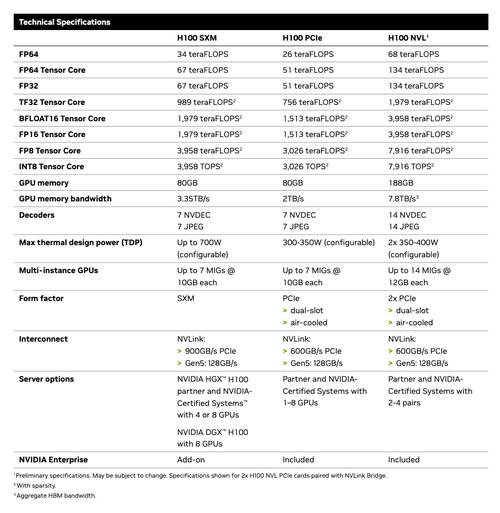

对比H100与4090:两者谁才是更好的GPU算力选取?

〖壹〗、总结: 如果你主要关注推理任务,且预算有限,4090可能是更好的选取,特别是在考虑到UCloud等云服务商提供的高性价比云服务器时。 如果你对训练任务有更高性能需求,且预算充足,H100可能更适合。在选取时,请务必根据实际需求、预算和任务类型进行综合考虑。

〖贰〗、总结来说,如果你主要关注推理任务,且预算有限,4090可能是更好的选取;而对训练任务有更高性能需求的用户,H100可能更适合。不过,UCloud的4090云服务器以其高性价比提供了更灵活的使用方式,值得考虑。

〖叁〗、在探讨大模型微调时选取GPU的问题时,将RTX 4090比作「经济适用男」,而将H100比作「隐形富豪」,这一比喻形象且贴切。下面,我们根据具体性能和适用场景,详细分析这两种GPU的特点。

〖肆〗、在部署AI模型、搭建训练机、规划算力资源时,GPU的选取至关重要。4090、A100、H100、H20作为当前市场上的主流GPU型号,各自具有不同的定位和性能特点。以下是对这些GPU型号的定位、性能差异与应用场景的详细分析:GPU主流型号概览 4090:基于Ada Lovelace架构,支持FP16/TF32精度,拥有24GB显存。

〖伍〗、在算力方面,H100 PCIe相对于A100 PCIe提供了约两倍的性能提升(尽管费用更高、功耗更大),并增加了FP8支持,但INT4性能被阉割。4090在算力上远超A10,特别是在使用Tensor Core的精度下表现更为突出。尽管A10功耗较低,但在计算性能上无法与4090相比。

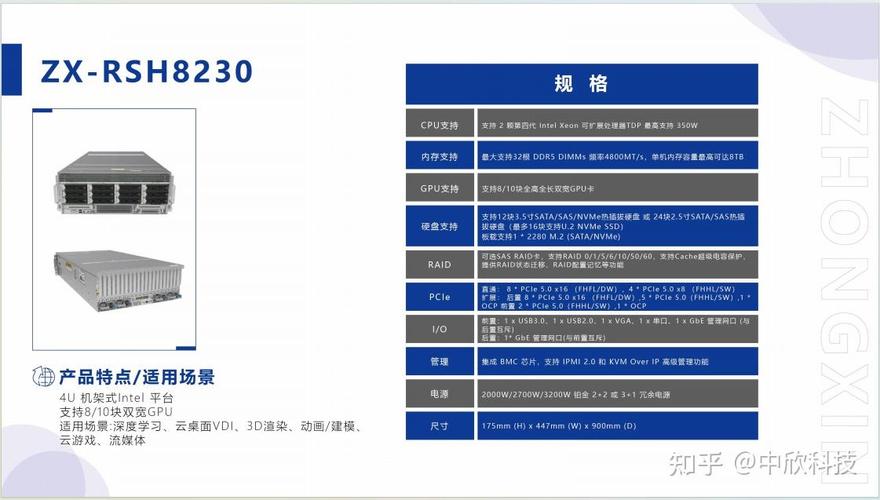

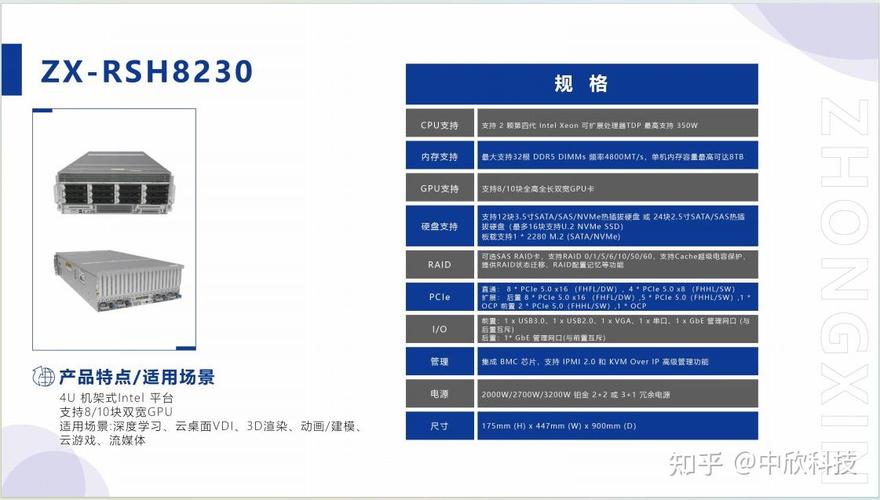

8块4090显卡!机架式GPU服务器方案

针对您提出的机架式GPU服务器方案需求,以下是一个基于8块NVIDIA Geforce RTX 4090显卡的详细方案。此方案旨在提供强大的计算力,以支持复杂的数据分析、机器学习及深度学习等任务。服务器基础配置 机箱:选取一款高质量的机架式服务器机箱,确保有足够的空间和散热能力来容纳8块RTX 4090显卡。

卡英伟达4090深度学习服务器 这款服务器搭载了8张NVIDIA Geforce RTX 4090涡轮版显卡,以其极致的计算性能和效率,能够显著减少深度学习模型的训练和推理任务时间。

任务调度优化:采用Kubernetes集群管理,提高GPU利用率至85%以上。硬件迭代规划:与机房签订3年以上合约可获得15-20%的电费折扣。综上所述,托管八卡4090算力服务器到苏州胜网高电机房或中国电信苏州太湖世界数据中心都是较为划算的选取。

张4090跑70B参数的详细解释如下:显卡配置:8张NVIDIA RTX 4090 48GB GPU可以支撑70B(即700亿)参数大模型的分布式训练。这种配置能够轻松实现高效并行计算,无论是多模态联合优化还是超大规模语言模型微调。

国鑫4090服务器性能提升35%,推理效率与能效实现双飞跃 国鑫通过全栈垂直优化技术,成功实现了其全系列8卡GPU服务器在NCCL(NVIDIA Collective Communications Library)性能上的显著提升,比较高可达35%。

阿里云4060或4090显卡配置多少钱?GPU服务器最新费用总结

〖壹〗、配置:24GB显存,16核CPU,60GB内存。费用:按量付费低至95元/小时。适用场景:中等规模深度学习推理、高性能图形渲染、科学计算等。GPU服务器优惠折扣 阿里云GPU服务器提供多种计费模式和优惠折扣,具体如下:按量付费:按小时收费,新用户可享受1折优惠,但最长享受100小时的1折低价。

〖贰〗、以2025年的某些特定配置为例,4090八卡GPU服务器租赁费用,按小时计费的费用区间为9元至3元/小时。

〖叁〗、预算是选取GPU服务器时需要考虑的重要因素。不同型号的GPU服务器在费用上存在较大差异。例如,莱卡云的T4 GPU服务器月付费用在200-400元之间,而RTX 3090/4090和A100 GPU服务器的费用则分别高达2000-4000元和8000元以上。因此,在选取时需要根据自己的预算进行合理规划。

〖肆〗、中小企业务实方案约5万元,含1 - 2张RTX 4090显卡+128GB内存+2T NVMe SSD,可支持7B参数模型推理与微调。选取云厂商一体机(如阿里云、百度云),费用在50万 - 100万元,含模型与算力适配。中大型企业/行业级场景,费用为几十万至数百万。

〖伍〗、机架式GPU服务器方案,搭载8块4090显卡 针对您提出的机架式GPU服务器方案需求,以下是一个基于8块NVIDIA Geforce RTX 4090显卡的详细方案。此方案旨在提供强大的计算力,以支持复杂的数据分析、机器学习及深度学习等任务。

〖陆〗、部署场景与配置方案 本地开发:适用于个人开发者或小型团队测试。推荐配置为NVIDIA 3090/4090(24GB)显卡、128GB内存,以及Ollama + Chatbox等工具。生产推理:适用于企业级高并发服务或API接口部署。推荐配置为A100 40GB/H100 80GB(多卡并行)显卡、256GB+内存、高带宽低延迟网络。

美国4090显卡服务器:提升渲染效率与画质的终极选取

〖壹〗、显卡服务器凭借其强大的Ada Lovelace架构,已成为当前市场上提升渲染效率与画质的终极选取。以下是对美国4090显卡服务器的详细解析,以及其在不同渲染场景下的应用优势。4090显卡的技术前沿 4090显卡代表了当前GPU技术的最前沿,其Ada Lovelace架构为用户提供了卓越的渲染速度和图形处理能力。

〖贰〗、RTX 4090 在 2025 年的算力租赁市场中,已从单纯的硬件产品进化为普惠创新的基础设施。算力租赁不仅为企业带来了成本优化和效率提升的双重优势,更推动了企业级算力获取范式的深刻变革。随着技术的不断进步和市场的持续发展,RTX 4090 租赁模式将持续引领算力民主化浪潮,为数字经济发展注入强劲动力。

〖叁〗、魔改4090的核心操作 华强北的魔改方案主要包括三个步骤:移植4090核心到3090 PCB板、双面焊接48颗GDDR6X显存、破解BIOS。这一系列操作使得原本受限于显存容量的4090显卡,摇身一变成为拥有48GB显存的超级显卡。

〖肆〗、帧数稳定性:帧数稳定性与显卡及CPU匹配度密切相关。一个高性能的CPU和适当的显卡位宽能够协同工作,进一步提升帧数稳定性和整体渲染效率。推荐配置:根据显卡的位宽,可以选取相应的处理器。

〖伍〗、一个高性能的CPU能够协同显卡工作,进一步提升帧数稳定性和整体渲染效率。CPU对渲染速度影响其实不大,但是渲染前的准备时间会更长。选取顶级处理器(如14900K和7950X)会缩短模型导入、渲染前准备时间,但应根据自身需求考虑。根据显卡位宽选取对应的处理器,以确保最佳匹配和性能发挥。

〖陆〗、影视渲染效率也得到了飙升,洛克特影视公司通过 30 台赞奇云桌面,将电影项目渲染时间从 10 小时压缩至 1 小时,效率提升 300%。对于游戏玩家来说,赞奇云桌面是终极装备。云端配备 RTX 4090 显卡,可流畅运行《赛博朋克 2077》《原神》等大型游戏,画质全开不卡顿。

2024年8月!!!当下最火GPU服务器你知道是哪几款吗?

〖壹〗、年8月当下最火的GPU服务器是4卡安静4090工作站以及相关的双卡4090工作站和四卡4090塔式静音服务器。以下是对这几款服务器的详细介绍:4卡安静4090工作站 这款GPU服务器以其极致的计算性能和效率,显著减少了训练推理任务的时间,被誉为性能怪兽。

〖贰〗、卡英伟达4090深度学习服务器 这款服务器搭载了8张NVIDIA Geforce RTX 4090涡轮版显卡,以其极致的计算性能和效率,能够显著减少深度学习模型的训练和推理任务时间。

〖叁〗、高性能计算服务器推荐:超越想象的4卡英伟达4090深度学习GPU服务器 在2024年下半年的深度学习领域,一款全新的高性能计算服务器正以其卓越的性能和创新的配置引领着行业的革新。

文章分享结束,gpu服务器4090和gpu服务器是干什么的的答案你都知道了吗?欢迎再次光临本站哦!